Estafas románticas impulsadas por IA: el punto ciego de la banca digital

Las estafas románticas se consolidan como uno de los fraudes financieros de mayor crecimiento a nivel global, ahora potenciadas por el uso de Inteligencia Artificial. Según el Informe Global de Crímenes Financieros 2024 de Nasdaq, las estafas románticas y otros engaños de confianza provocaron pérdidas anuales estimadas en 3.800 millones de dólares en todo el mundo.

De acuerdo con datos difundidos por BioCatch el 10 de febrero de 2026, el uso de herramientas de IA generativa permitió a los ciberdelincuentes sofisticar sus métodos y aumentar el alcance de estos delitos. Clientes de la compañía reportaron un incremento del 63% en estafas románticas entre 2024 y 2025.

Josué Martínez, Global Advisor para BioCatch Latinoamérica, señala que el auge de aplicaciones de citas y redes sociales, combinado con la Inteligencia Artificial, facilita la creación de perfiles falsos altamente convincentes, incluso con audios y videos manipulados para suplantar identidades.

La IA potencia estas estafas a través de cuatro mecanismos principales:

– Deepfakes y suplantación visual: generación de imágenes y videos hiperrealistas que dificultan la detección mediante herramientas tradicionales como la búsqueda inversa.

– Clonación de voz: utilización de audios sintéticos para simular emergencias o situaciones de crisis, como secuestros virtuales.

– Chatbots basados en modelos de lenguaje (LLMs): mantenimiento de conversaciones constantes, coherentes y emocionalmente convincentes con múltiples víctimas en simultáneo.

– Automatización masiva: creación a gran escala de historias personales falsas y análisis de vulnerabilidades psicológicas.

Las estafas suelen comenzar en plataformas como WhatsApp, Instagram o Facebook, donde los delincuentes construyen vínculos emocionales durante semanas o meses antes de solicitar transferencias de dinero. A diferencia de otros fraudes, aquí la víctima realiza las operaciones con sus propias credenciales, dispositivos y métodos de autenticación habituales. Esto representa el “punto ciego” de la banca: no hay señales técnicas de cuenta comprometida porque el comportamiento digital aparenta ser legítimo.

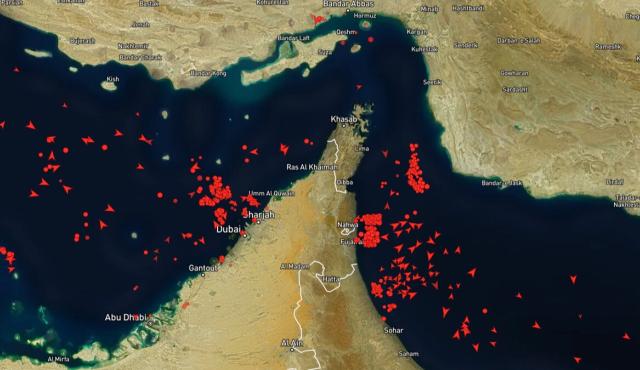

Además, los fondos suelen enviarse a cuentas “mula”, es decir, cuentas reales de terceros reclutados para mover dinero ilícito, lo que dificulta el rastreo y la detección temprana.

Uno de los casos emblemáticos fue el de Cecilie Fjellhoy, conocida por el documental El estafador de Tinder y luego por Love Con Revenge (Netflix). Tras entablar una relación online con un hombre que fingía ser CEO de una empresa de diamantes, perdió más de 200.000 libras, contrajo deudas y enfrentó procesos judiciales con bancos. Más allá del daño económico, el impacto emocional fue profundo. Según datos de Visa, el 26% de las víctimas de fraudes por pagos autorizados (APP) necesitó apoyo o asesoramiento en salud mental.

Ante este escenario, BioCatch sostiene que la Biometría Conductual puede convertirse en una herramienta clave. Esta tecnología analiza cómo interactúa el usuario con la app o la web bancaria —velocidad de tecleo, movimientos del mouse, pausas, presión al escribir— y detecta cambios asociados a estrés, coacción o indecisión.

Según testimonios difundidos por la compañía, un banco mejoró su tasa de detección de estafas en un 67% durante el primer mes de implementación, identificando más del 77% de intentos de fraude. En meses posteriores, la detección alcanzó casi el 84%. Otra entidad reportó una mejora inicial del 73%.

Las recomendaciones para los usuarios son claras: no enviar dinero ni tarjetas de regalo a personas que no se conocen presencialmente, no compartir información financiera por teléfono o mensajes, y evitar responder contactos de números desconocidos. La sofisticación tecnológica crece, pero las señales básicas de prevención siguen vigentes.

El avance de la Inteligencia Artificial no solo redefine la innovación financiera, sino también el fraude digital. Para el sistema bancario, el desafío ya no es solo tecnológico: es comprender que la ingeniería social opera sobre la confianza, y que esa variable no siempre se detecta con los métodos tradicionales de seguridad.