La empresa sin humanos ya dejó de ser ciencia ficción: así funcionan las organizaciones impulsadas por agentes de IA

Durante décadas, la automatización fue presentada como una herramienta para mejorar la productividad humana. Luego, la Inteligencia Artificial amplió ese horizonte: escribir, programar, analizar datos. Pero lo que empieza a emerger ahora va un paso más allá y obliga a replantear una pregunta estructural: qué ocurre cuando no solo se automatizan tareas, sino la totalidad de una organización.

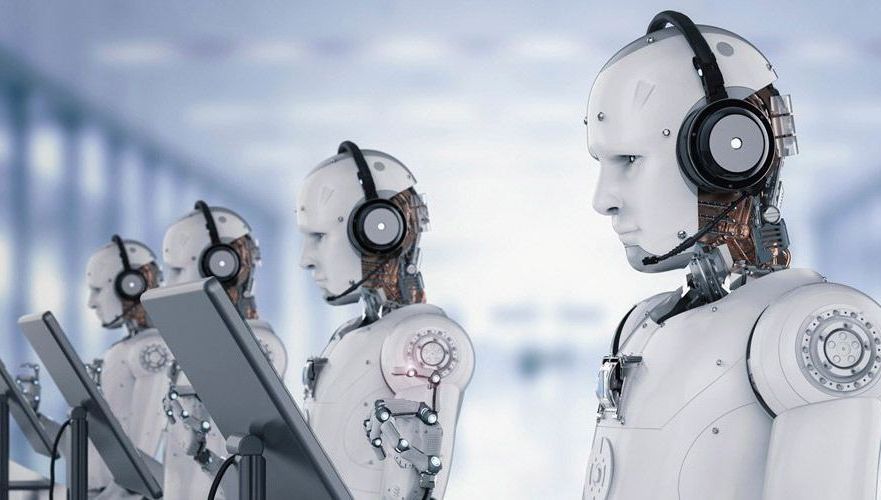

En los entornos más avanzados del ecosistema tecnológico ya se está experimentando con una idea que hasta hace poco parecía teórica: empresas operadas íntegramente por agentes de IA. No se trata de robots físicos ni de fábricas automatizadas, sino de estructuras digitales donde cada rol —desde la dirección hasta la ejecución— es ocupado por software inteligente. La llamada “empresa sin humanos” ya no es una hipótesis. Es un modelo incipiente, pero operativo.

El cambio central no es tecnológico, sino conceptual. Durante años, la IA fue entendida como un asistente que responde a pedidos humanos. Hoy, ese esquema empieza a invertirse. En lugar de interactuar con una única IA, emergen sistemas compuestos por múltiples agentes especializados que colaboran entre sí. Unos investigan, otros redactan, otros ejecutan tareas técnicas, otros analizan resultados y otros toman decisiones tácticas. La clave ya no está en la capacidad individual, sino en la coordinación entre sistemas.

A partir de esa lógica, comienzan a aparecer estructuras que imitan el funcionamiento de una empresa tradicional. Los agentes no operan de forma aislada, sino que se organizan con jerarquías, responsabilidades y objetivos compartidos. Algunos coordinan, otros ejecutan y otros supervisan resultados. La diferencia es sustancial: todos los “empleados” son entidades de software y la operación puede sostenerse de forma continua, sin intervención humana directa.

El funcionamiento, en términos generales, replica principios clásicos de gestión. Todo parte de un objetivo claro —lanzar un producto, generar ingresos, posicionar una marca— que actúa como estrategia. A partir de ahí se definen roles, se estructura una organización y se pone en marcha un sistema capaz de generar tareas, ejecutarlas, evaluar resultados y ajustar su propio comportamiento. En ese esquema, el rol humano cambia de manera profunda: deja de ser ejecutor para convertirse en diseñador del sistema, supervisor y corrector de desvíos.

Lo más disruptivo de este modelo no es que la IA haga más cosas, sino que pueda trabajar de forma articulada bajo una lógica organizacional coherente. Durante años, el límite no fue la capacidad de los sistemas, sino su falta de coordinación. Tener múltiples inteligencias no garantizaba resultados si no existía una arquitectura que las integrara. Las nuevas plataformas avanzan precisamente sobre ese punto: funcionan como una capa que permite a distintos agentes comunicarse, coordinarse y avanzar hacia un objetivo común. En términos prácticos, convierten múltiples inteligencias en un sistema productivo unificado.

Ahora bien, hay que evitar simplificaciones. Una interpretación posible es que este modelo represente una evolución natural de la automatización, con empresas más eficientes, escalables y menos dependientes del trabajo humano. El riesgo en ese escenario es evidente: concentración de poder tecnológico y desplazamiento acelerado de empleos. Otra lectura, más cauta, sostiene que la idea de una empresa completamente autónoma todavía está sobredimensionada. La infraestructura, la definición estratégica y la supervisión siguen dependiendo de humanos. En ese caso, el riesgo es otro: confundir experimentos controlados con soluciones listas para escalar.

También hay supuestos que aún no están resueltos: que los agentes puedan tomar decisiones complejas sin amplificar sesgos, que la coordinación funcione de manera estable a gran escala y que los marcos regulatorios acompañen esta transformación. Son variables abiertas que van a definir el ritmo real de adopción.

Como suele ocurrir en tecnología, lo que hoy aparece como experimental puede convertirse en estándar en menos tiempo del esperado. La discusión ya no pasa por si estas organizaciones van a existir, sino por dónde, cómo y bajo qué condiciones van a operar.